Explore DeepSeek

据说幻方科技这家量化公司在几年前显卡被制裁前囤积了不少A100,因此能负担这种规模的模型训练。

关于RL

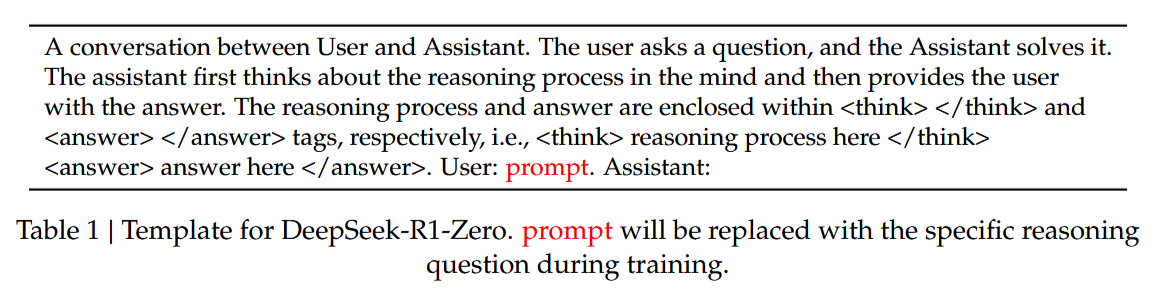

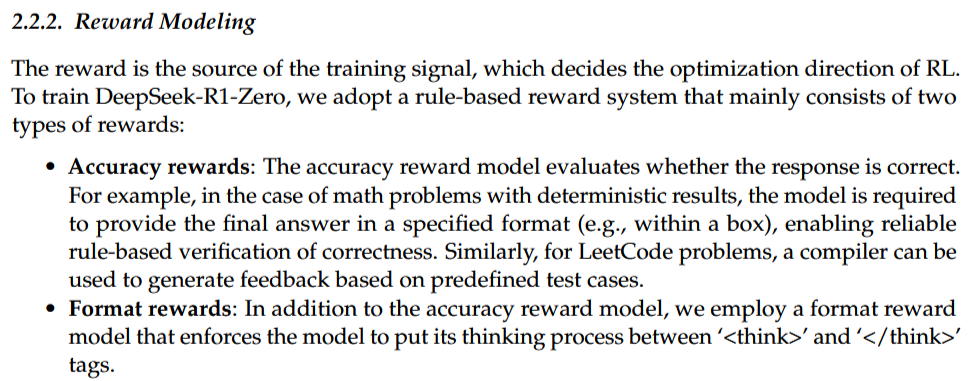

DeepSeek-R1-zero采用无SFT(Supervised Fine-Tuning)的方式进行大规模RL训练,reward如下:

准确率奖励

格式奖励:对思维链条(CoT,Chain of Thought)进行建模,作为输出

<think>...</think>部分的奖励

结果表明不靠传统的SFT,纯RL的训练方法对于LLM训练是具有可行性的。R1-zero的性能和OpenAI-o1接近。

搜了一下,主流LLM训练中也采用了RL的方法,同时也是训练的核心,deepseek在这一点上并非totally brand new,重点是提升了CoT的侧重,以及把SFT的部分优化掉了(后续的R1将其少量加入,作为冷启动,但重点仍然是RL)。

那么一个问题是,RL虽然理论上一定能收敛,但没有SFT提供比较好的初始值,收敛速度怎么样。但结果看起来,CoT方面的RL训练cover掉了这个问题?

另外感觉有意思的是,对CoT进行RL的思路是不是比较拟人,或者说,对这个过程的理解可以不从概率模型的角度,而是只从人类的逻辑推理角度出发,目标是实现逻辑本身的端到端学习,这样得到的就是“思考机器”,而不是“真理机器”。

理论和实验的分析在这篇知乎文章里写的比较详细,后边还有模型蒸馏部分,各种对比实验和讨论。鼠鼠理论深度还是不太够,稍微关注下具体的效果。

国产之光?

网页端和app免费开放了671B的R1版本,也提供了本地部署蒸馏模型的方法,回校以后拿台式机试试。目前在网页端R1的体验和GPT-4比较类似——

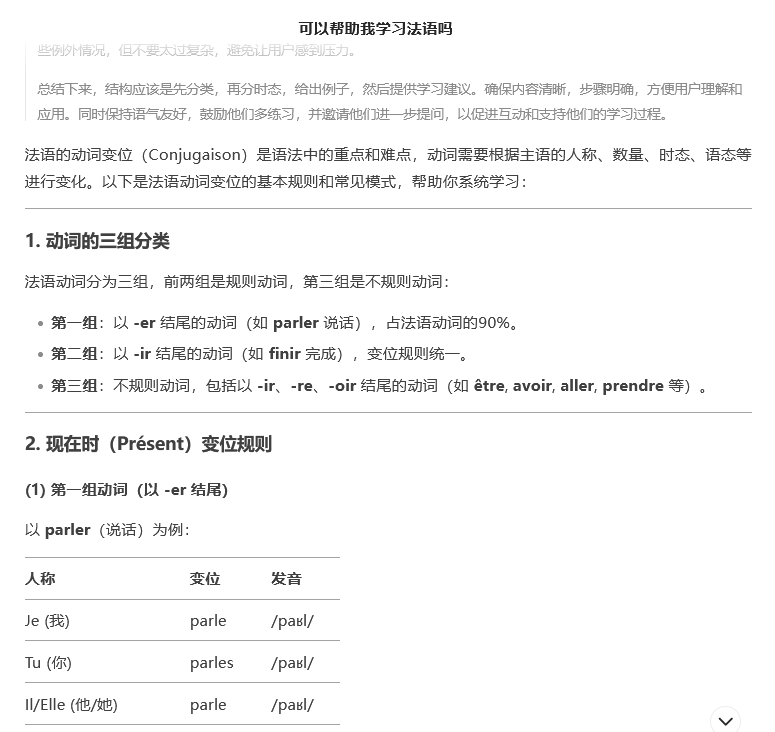

日常任务:学法语的体验优于限量版的GPT-4口牙!

不过目前不支持图片输入(附件只能读取文本信息)。总的来说在手机上下载一个日常用途的app还是很方便的,不用担心墙的问题。缺点是服务量太大,经常卡顿。

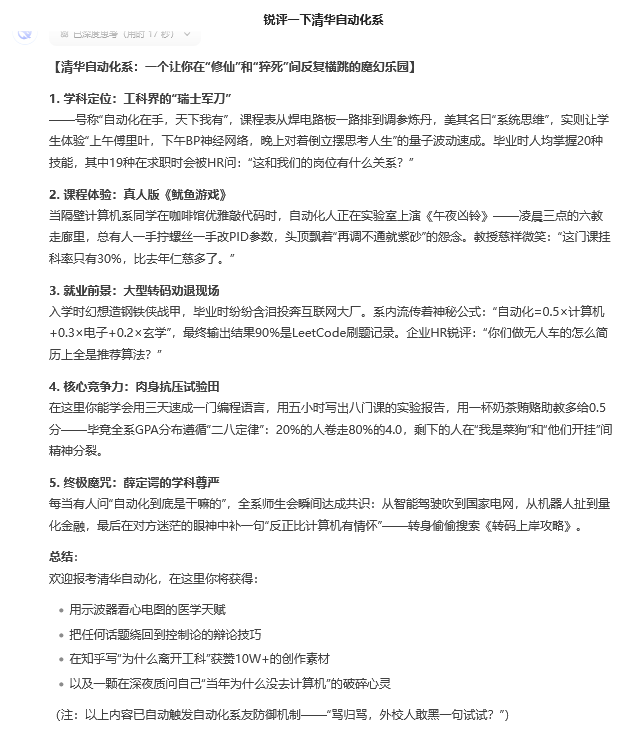

哪里来的逆天语料库

我自己试了一下,和网上别人prompt出来的结果差不多,它的潜能在攻击性上简直深不见底。。。它从简中互联网上学了太多东西了。

读取pdf

还行,但还是只能读文字内容。